Was KI in der Software-Entwicklung leisten kann – und was nicht

KI-Tools machen Developer produktiver, zumindest was den Output von Code betrifft. Doch die Produktivitätssteigerung auf der individuellen Ebene nutzt Unternehmen nicht viel, solange sie ihre Entwicklungsprozesse nicht neu justieren.

In keinem anderen Bereich hat sich generative KI (GenAI) so schnell durchgesetzt wie in der Software-Entwicklung. Der Einsatz von KI-Tools gehört inzwischen in den meisten Unternehmen zur Normalität, deren Nutzen ist unbestritten: Code-Generatoren produzieren Standardroutinen auf Knopfdruck oder übernehmen die zeitaufwändige Dokumentation, Debugging- und Test-Tools helfen bei der Qualitätssicherung. Laut einer Umfrage der Developer-Plattform Stack Overflow nutzen 84 Prozent der fast 34.000 befragten Entwickler bereits KI-Tools oder haben dies zumindest demnächst vor.

Die Haltung der Entwickler gegenüber KI-Tools ist nicht mehr so positiv wie vor zwei Jahren.

Doch die Euphorie aus der Anfangszeit von ChatGPT & Co. ist verflogen, langsam macht sich Skepsis breit. So ist die positive Haltung gegenüber den Tools von über 70 Prozent im letzten Jahr auf etwa 60 Prozent gesunken, und der Qualität des von KI generierten Codes vertrauen nicht mehr 42, sondern nur noch 33 Prozent. Zudem geht die Produktivitätssteigerung bei der individuellen Arbeit der Entwickler, die eine Studie von GitHub Research bei stolzen 55 Prozent schätzt, mit einer Reihe von Risiken und Nebenwirkungen einher, die Programmierer und ihre Organisationen in der Anfangszeit nicht auf der Rechnung hatten – und zu einem großen Teil immer noch nicht haben.

Was KI in der Software-Entwicklung so populär macht

Dass generative KI trotz ihrer Fehleranfälligkeit und den berüchtigten Halluzinationen gerade in dieser Branche so erfolgreich eingesetzt wird, hat sehr viel mit den Einschränkungen zu tun, denen Programmiersprachen unterliegen. „All diese Einschränkungen bilden Leitplanken, die die Neigung der LLMs zu Halluzinationen in Schach halten“, erklärt ein Entwickler auf Substack. Außerdem sei der Prozess der Software-Entwicklung darauf ausgelegt, Fehler möglichst früh und effektiv zu identifizieren. „LLMs können falsche Syntax und nicht existierende API-Aufrufe halluzinieren (und das tun sie oft), aber sie kommen damit nicht weit, da der Code nicht kompiliert werden kann. Sie können schlampigen Code und falsche Implementierungen halluzinieren, aber die Linter schlagen Alarm und die Tests schlagen fehl.“

Die Einfachheit, mit der sich mithilfe von KI Programmiercode generieren lässt, verleitet viele Entwickler dazu zu glauben, dass sie damit schneller gute Software abliefern können. Die Studien und Statistiken zu KI-generierter Software zeigen eine andere Realität. So berichteten im letztjährigen Qodo State of AI Code Quality Report drei von vier Entwicklern, dass sie häufig mit Fehlern und Halluzinationen zu kämpfen haben. Zudem fielen beim GenAI Code Security Report von Veracode 45 Prozent der Codebeispiele bei Sicherheitsprüfungen durch. Als eine der größten Herausforderungen gilt die Eigenschaft der KI, Code zu liefern, der „fast richtig“ ist – der Code kompiliert und besteht die Tests, beinhaltet aber Elemente, die sich im Nachhinein als problematisch erweisen.

KI kann die Programmierung auch verlangsamen

Die Probleme beginnen in dem Augenblick, in dem dieser Code in den Produktivbetrieb übergeht, nur um später sogenannte „technische Schulden“ zu verursachen – nachgelagerte Arbeiten, um Fehler zu korrigieren oder die Code-Qualität zu erhöhen, damit die Software weiterhin in Betrieb gehalten werden kann. Hinzu kommt, dass laut Stack-Overflow-Umfrage 45 Prozent der befragten Entwickler der Ansicht sind, dass KI-generierter Code schwieriger zu debuggen ist als selbsterstellter Code.

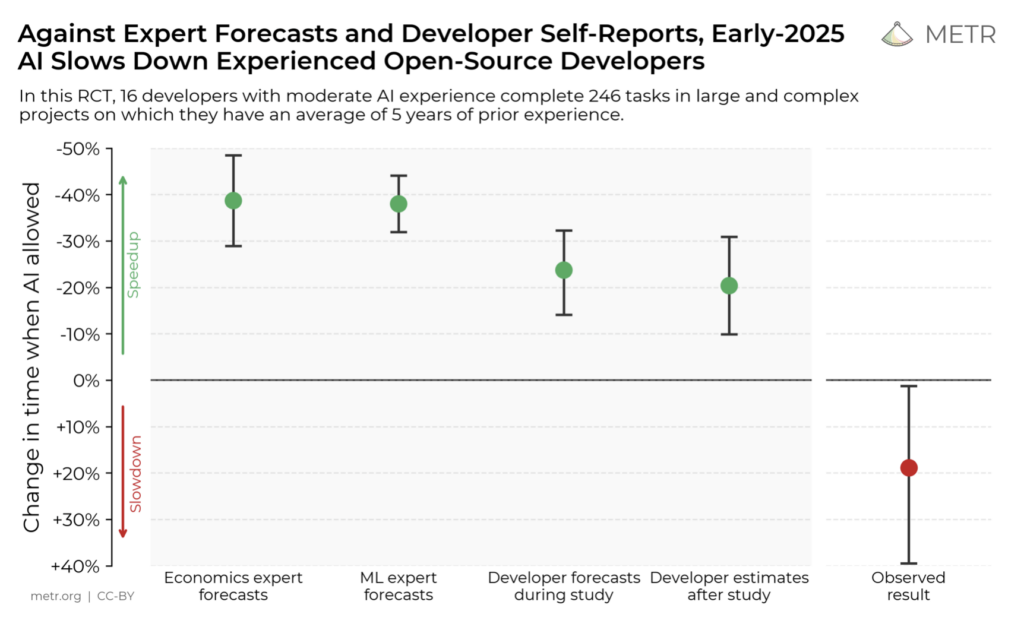

All das erklärt ein Stück weit die Skepsis und den Vertrauensverlust, der in den Umfragen so deutlich zum Ausdruck kommt. Denn wenn der Code, den die KI abliefert, so viel nachträgliche Arbeit verursacht, wie viel bleibt von der erhofften Zeitersparnis noch übrig? Eine Antwort darauf versucht eine Studie von METR zu liefern. Hierfür mussten 16 Entwickler 246 Tasks in großen und kleinen Projekten durchführen, in welchen sie jeweils durchschnittlich fünf Jahre Erfahrung hatten. Fazit: Die Nutzung von KI hat ihre Arbeit nicht beschleunigt, sondern um 19 Prozent verlangsamt.

Dieses Ergebnis widerspricht nicht nur den Prognosen von Wirtschafts- und KI-Experten, sondern auch die Erwartungen der Entwickler selbst. „Die Diskrepanz zwischen Wahrnehmung und Realität ist eklatant“, kommentieren die Autoren. „Die Entwickler hatten erwartet, dass KI ihre Arbeitsgeschwindigkeit um 24 Prozent steigern würde, und selbst nach der Verlangsamung glaubten sie immer noch, dass KI ihre Geschwindigkeit um 20 Prozent gesteigert hat.“

Sorgen um den Nachwuchs

Dennoch wird KI langfristig eine tragende Rolle in der Software-Entwicklung spielen. Zum einen werden die KI-gestützten Tools immer besser, zum anderen macht sich in den Unternehmen die Erkenntnis breit, dass sie ihre Prozesse, Personalstrukturen und Tätigkeitsprofile anpassen müssen, um die neue Technologie sinnvoll einsetzen zu können. Experten zufolge sollen sich Entwickler künftig weniger mit dem Schreiben von Code, sondern mit dessen Überprüfung und mit System- bzw. Anwendungsarchitektur beschäftigen. Code zu verfassen gilt in vielen Unternehmen bereits als überholt, weshalb in den USA auch die Zahl der Einstiegsstellen im Technologiesektor zwischen 2023 und 2024 um 67 Prozent gesunken ist.

Unternehmen setzen immer mehr auf KI als auf Junior Developer und Auszubildende.

Diese Reaktion der Unternehmen ist zwar sehr gut nachvollziehbar, birgt aber langfristig Gefahren. Rainer Alföldi ist CEO und Gründer von arc46, eines auf die Entwicklung von No-Code-Integrationslösungen spezialisierten Unternehmens, und kennt die Produktivitätsfalle, in die jüngere Entwickler gerne tappen, nur zu gut. Er erzählt, wie er neulich einen Auszubildenden im Team-Chat über den grünen Klee lobte, weil er seine Aufgabe sehr schnell und ordentlich gelöst hatte. Unter vier Augen fragte er ihn anschließend, wie viel vom abgelieferten Code er tatsächlich selbst geschrieben hat. Es stellte sich heraus, dass der Code komplett KI-generiert war.

„Das eigentliche Problem ist aber ein anderes“, erklärt Alföldi. „Ich benutze ja selbst gelegentlich KI, um meinen Code prüfen zu lassen, und die KI findet sehr brav alles, was irgendwie außerhalb der Norm ist. Ich selbst verstehe sehr gut, was sie beanstandet, aber ich weiß auch, warum ich etwas absichtlich so gemacht habe. Aber wie soll dieser junge Entwickler in zehn Jahren imstande sein, der KI zu widersprechen oder sie zu korrigieren?“

KI erfordert neue Entwicklungsprozesse

Kevin Scott, Chief Technology Officer von Microsoft, sagte vor einem Jahr voraus, dass spätestens 2030 etwa 95 Prozent der Software von KI geschrieben werden wird. Gleichzeitig geht er nicht davon aus, dass deswegen Entwickler arbeitslos werden. Statt selbst Code zu schreiben, würden sie KI-Tools die Code-Erstellung überlassen, auf Basis von Prompts und Anweisungen. Dies aber würde zur Folge haben, dass Unternehmen ihre Arbeitsabläufe grundlegend verändern müssen.

Laut dem State of AI-assisted Software Development Report von Google sollten Unternehmen ein „Value Stream Management“ in ihre Software-Entwicklungsprozesse einführen und sich nicht allein auf die Geschwindigkeit der Auslieferung konzentrieren. Stattdessen sollten sie für einen barrierefreien Durchfluss des Codes durch die verschiedenen Phasen des Prozesses sorgen und sich auf die kontinuierliche Verbesserung des Codes fokussieren. Außer einer Neustrukturierung ihrer Prozesse bedingt dies allerdings auch eine Neuverteilung der Aufgaben und Rollen in den Entwicklungsteams.

„KI wirkt als Verstärker – aber nur, wenn die Organisation darauf vorbereitet ist“, so lautet das Fazit des Fraunhofer IESE (Institut für experimentelles Software Engineering) nach einer Auswertung zahlreicher Studien zu diesem Thema letzten Oktober. KI könne zwar die Produktivität einzelner Entwickler deutlich steigern, doch die lokalen Produktivitätsgewinne würden nicht automatisch zu besseren Ergebnissen auf Systemebene führen. Die Daten der oben zitierten Google-Studie würden sogar auf eine Zunahme von Lieferinstabilität hindeuten. „Das zeigt: Ohne ein stabiles Downstream-Fundament, etwa in Architektur, Plattformqualität und Governance, verpufft der Nutzen“, so das Fraunhofer IESE.